第 11 章:VLM 强化学习——让视觉模型学会推理

前面章节里,我们已经把 RL 从游戏环境一路推进到大模型后训练:DQN 学会从像素里打 Atari,PPO 学会稳定更新策略,DPO/GRPO 学会用偏好或可验证奖励优化语言模型。但这些任务大多只处理一种输入:状态向量、像素,或者 token 序列。

真实世界不是纯文本的。你看到的是图片、视频、图表、屏幕截图、3D 场景;你需要先理解视觉信息,再把它转化成推理、决策和行动。视觉-语言模型(Vision-Language Model, VLM)把图像和语言接到同一个模型里,而强化学习则进一步追问:模型不只是会描述图片,它能不能因为结果反馈而学会看得更准、想得更稳、答得更可靠?

把 RL 从纯文本搬到多模态,听起来像是“换个输入格式就行”:GRPO 的核心代码似乎只要把 token 序列换成“视觉 token + 文本 token”的序列。但真正训练起来,你会立刻遇到一组纯文本 RL 没有的问题:

- 奖励该归因给谁? 答错了,是视觉编码器没看清,还是语言模型推理错了?

- 视觉编码器要不要跟着 RL 更新? 更新太猛可能让模型“失明”,完全冻结又学不到新的视觉能力。

- 模型会不会假装看图? 如果“猜答案”也能拿到高奖励,RL 可能强化视觉幻觉。

- 视觉输入如何连接行动? 在自动驾驶、机器人、GUI Agent 中,VLM 的回答会影响真实决策,安全和延迟都变成训练约束。

本章的目标,就是把这些问题拆开:先用一个可复现的 GRPO 小实验建立直觉,再分析 VLM RL 的特殊挑战,接着看前沿框架如何把训练从静态数据集推向自博弈、工具增强和多模态 Agent,最后讨论视觉生成模型如何用 RL 做后训练。

前置知识回顾

本章会用到以下概念,如果记不清了,点进去复习一下再继续:

- GRPO 算法——不用 Critic 的组内相对优化

- 奖励函数设计——规则奖励、模型奖励与 reward hacking

- PPO-RLHF 训练循环——KL 惩罚、梯度裁剪与参考模型

VLM RL 和纯文本 RL 有什么不同?

纯文本 RL 里,模型的输入和输出都在 token 空间中。一个回答不好,我们通常只需要问:生成的 token 是否符合奖励标准?VLM RL 多了一条视觉链路:图片先被视觉编码器切成 patch,再转成视觉 token,最后和问题文本一起进入语言模型。

这让训练目标从“让模型说得更好”变成“让模型先看对,再说对”。两者的差异可以压缩成一张表:

| 维度 | 纯文本 LLM RL | VLM RL |

|---|---|---|

| 输入 | prompt token | 图片 / 视频 / 截图 + prompt token |

| 关键模块 | 语言模型 | 视觉编码器 + 多模态投影层 + 语言模型 |

| 常见奖励 | 答案正确性、偏好分、格式奖励 | 视觉理解正确性、推理质量、grounding、安全性 |

| 主要风险 | reward hacking、模式坍缩 | 视觉幻觉、跨模态错误归因、视觉编码器退化 |

| 训练策略 | PPO、DPO、GRPO | GRPO/PPO + 差异化学习率 / 冻结视觉编码器 |

| 评估重点 | 答案是否好 | 是否真的看图、是否基于图像证据推理 |

最关键的变化是:奖励信号不再天然知道错误来自哪里。一个标量 reward 只能告诉你“这次回答不好”,却无法直接告诉你“是图像没看清”还是“文本推理错了”。这就是 VLM RL 的信用分配难题。

本章怎么学?

本章不是先堆论文名,而是按“能跑起来 → 看清问题 → 理解框架 → 扩展到生成”的顺序展开。读完之后,你应该能判断一个多模态 RL 任务到底是在训练视觉理解、文本推理、工具使用,还是生成质量。

| 小节 | 你会回答的问题 |

|---|---|

| 11.1 动手:GRPO 训练 VLM | 怎么用 GRPO 让 VLM 学会“看图再推理”?训练指标怎么看? |

| 11.2 视觉奖励与幻觉 | 视觉 token 的奖励怎么分配?视觉幻觉怎么应对? |

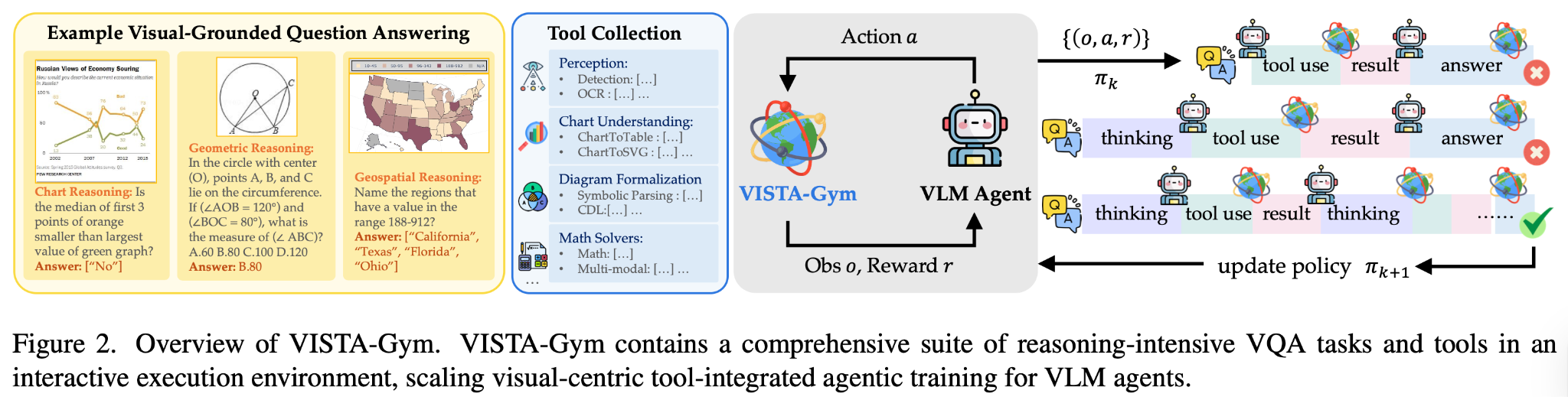

| 11.3 VLM RL 框架与前沿 | VisPlay、VISTA-Gym、多模态 Agent 等框架怎么工作? |

| 11.4 视觉生成模型的 RL 后训练 | Diffusion/视频生成怎么用 RL 优化?Reward 怎么设计? |

读完本章你应该带走什么?

第一,VLM RL 的算法骨架仍然来自前面学过的策略优化。GRPO 的组内比较、PPO 的 KL 约束、规则奖励的可验证性,这些概念不会因为输入变成图片就失效。

第二,多模态会把“奖励设计”变成更系统的问题。一个好的 reward 不只要判断答案对不对,还要检查模型有没有 grounded 到视觉证据、有没有编造不存在的物体、有没有为了高分牺牲安全性或可解释性。

第三,VLM RL 正在成为多模态 Agent 和具身智能之间的桥梁。它既连接语言模型的推理能力,也连接图像、视频、屏幕、机器人视角这些真实世界输入。理解这一章,再去看后面的自博弈、自进化和具身智能,就会更容易看清它们之间的技术脉络。

准备好后,我们先从一个最小但完整的实验开始:11.1 动手:用 GRPO 训练 VLM 回答视觉问题。